Любой вебмастер должен знать, что такое robots.txt и для чего он нужен, для того чтобы справиться с правильным заполнением этого файла. От правильности его заполнения зависит насколько индексация сайта пройдёт успешно.

Robots.txt: что это

Ответ на вопрос о том, что такое robots.txt находится в его названии. Это текстовый файл, т.е. документ в формате .txt. Этот файл является так же важнейшим инструментом во внутреннем СЕО-продвижении сайта, но многие недооценивают его важность и значение. В файле robots.txt содержаться инструкции, для того чтобы проиндексировать конкретный сайт.

Простыми словами, файл указывает, какие страницы нужно проиндексировать, а какие нет. Это требуется, потому что не вся информация, которая есть на сайте, нужна поисковым роботам. Существуют дубликаты страниц или системные файлы, которые совсем не обязательно индексировать.

Если вебмастер неправильно составляет файл robots.txt, то поисковые роботы, придя на Ваш сайт, начинают индексировать всё подряд. В этом случае, Ваша новейшая статья, например, о ценах разработки сайта-визитки может быть проиндексирована далеко, не в первую очередь, и сама индексация сайта будет затянута на продолжительное время.

Для чего нужен Robots.txt

Как мы уже сказали ранее, для чего нужен Robots.txt, так это для того чтобы избежать нежелательной индексации страниц, которые не содержат полезного контента. Этот файл должен быть размещён в корневой папке сайта.

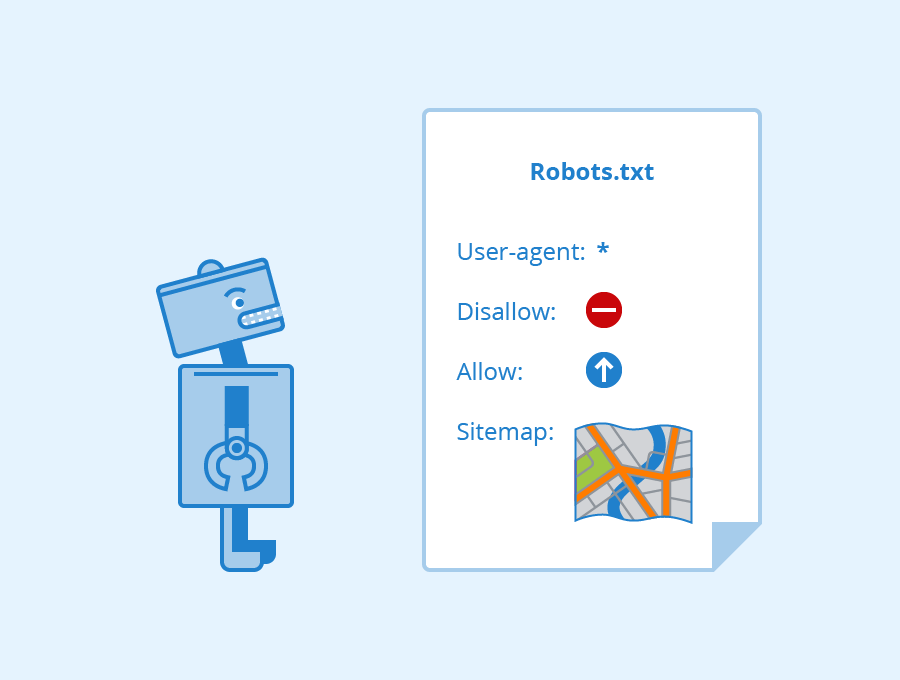

Существует так же возможность, когда файл robots.txt может не использоваться. Эта возможность есть у небольших сайтов, которые имеют простую структуру, для которых исключение каких-либо страниц из поиска может идти не в плюс. Само содержимое robots.txt представлен набором различных директив, т.е. правил. Ниже рассмотрим, какие бывают директивы и для чего они нужны:

- User-agent – задаёт название робота, для которого будут прописаны директивы ниже;

- Dissalow – запрет на индексацию каких-либо файлов или папок;

- Allow – снимает запрет на индексацию;

- Sitemap – определение пути до карты Вашего сайта;

- Host – здесь указывается главное зеркало Вашего сайта.

Robots.txt: что в нем писать

Для того чтобы понять, что писать в robots.txt нужно знать определенный синтаксис. Но, не смотря на его строгость, файл robots.txt написать довольно не сложно, он имеет весьма легкую и понятную структуру:

- Указание робота;

- Директивы для выполнения данным роботом;

- Дополнительные опции;

- Указание робота 2;

- Директивы для выполнения данным роботом;

- Дополнительные опции и т.д.

Для того чтобы исключить ряд ошибок, которые совершаются при написании файла, мы советуем следовать некоторым правилам:

- Начинайте каждую директиву с новой строки;

- Параметр директивы помещайте в одну строку;

- Пустой перевод строки может быть расценен, как конец такой директивы, как User-agent;

- В «Allow» и «Disallow» должно быть указано не больше одного параметра;

- Название самого файла robots.txt не должно быть прописано заглавными буквами (ROBOTS.TXT).

Чем грозит отсутствие robots.txt

В заключение скажем о том, чем же грозит отсутствие robots.txt и настолько ли это страшно. Отсутствие данного файла приводит к проблемам со скоростью обхода сайта роботами и к присутствию «мусора» в индексе. Если Вы знаете, что такое продвижение сайта и занимаетесь этим, то игнорирование файла robots.txt Вам ни к чему.

Неправильная настройка такого файла приведёт к исключению из индекса важных составляющих ресурса. Файл robots.txt – это важнейший инструмент для взаимодействия с роботами-поисковиками. Сегодня мы удостоверились, насколько важно обращать внимание этот файл и к чему может привести его отсутствие.